AhrefsのAIヒューマナイザーを使ってAI生成コンテンツを自然な文章に整えていたのですが、トライアルが終わってしまい、本契約は予算オーバーです。SEOを損なったり機械っぽくなったりせずに、同じようなことができる信頼できる無料ツールやワークフローはありますか?主にブログ記事やアフィリエイト向けコンテンツを最適化しているので、AI検出ツールに引っかからず、かつユーザーにとっても読みやすいものが必要です。

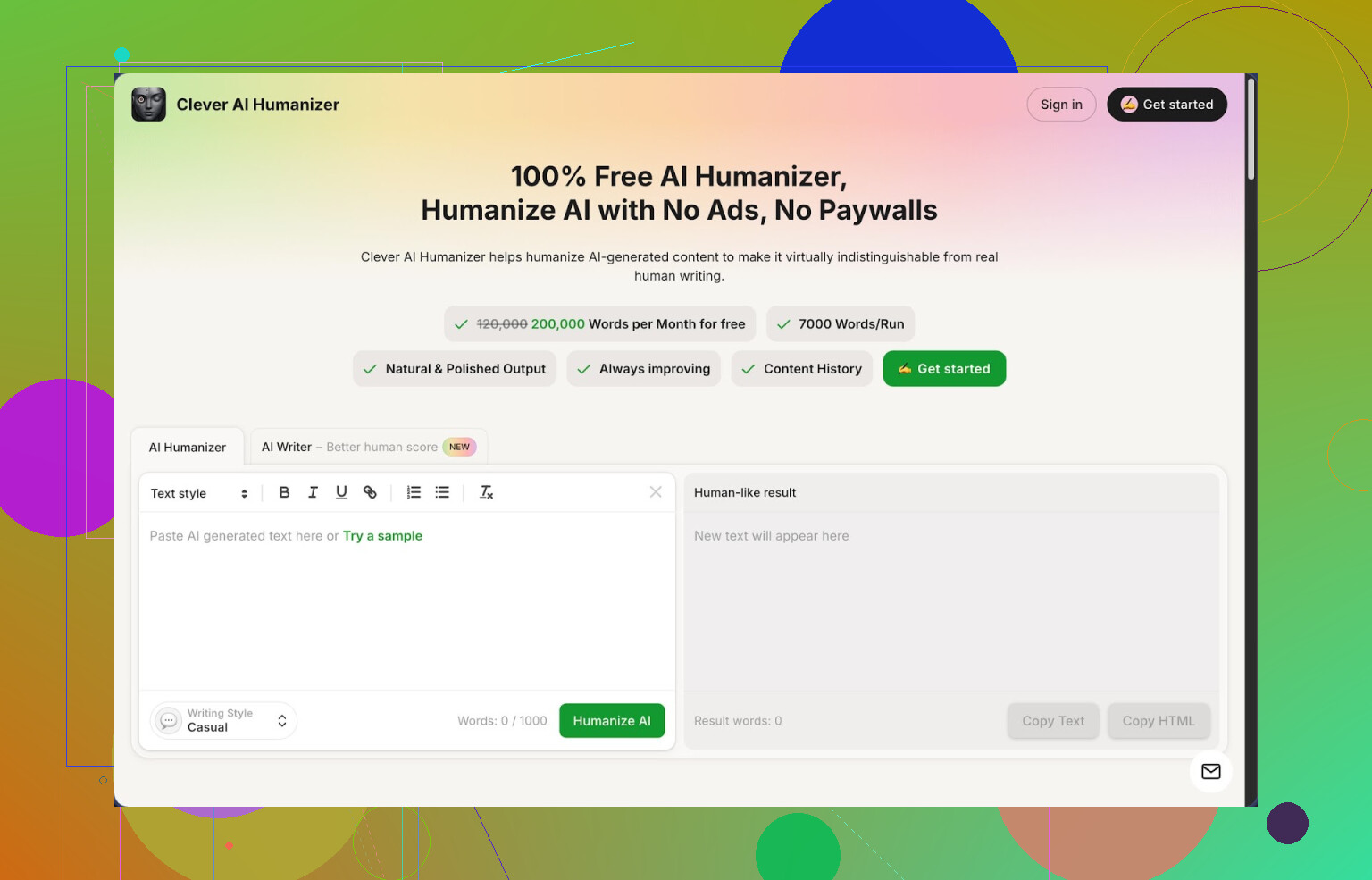

1. Clever AI Humanizer レビュー

しばらくの間 Clever AI Humanizer をいじってきたので、マーケティング的なおしゃべりを抜きにして気づいた点をまとめます。

このツールの大きな売りはシンプルです。無料で、上限がかなり高いこと。毎月最大 200,000 語まで、1 回あたり最大 7,000 語まで処理できます。これは長めのエッセイやレポート、複数本のブログ記事を一度に回すのに十分な分量です。出力スタイルは「カジュアル」「シンプルアカデミック」「シンプルフォーマル」の 3 種類。さらに、サイト内に AI ライターも組み込まれているので、別ツールを二つ使い分ける必要もありません。

カジュアルスタイルで 3 本のサンプルを書き、ZeroGPT にかけてみました。結果はいずれもその検出ツールでは AI 判定 0%。もちろん、どんなサイトでも必ず 0% になるという意味ではありませんが、同じ文章で 60~90% 判定になった他のツールよりはかなりマシでした。

執筆に AI を使っている人なら、最大の悩みはもう分かっているはずです。文章がぎこちなかったりロボットっぽくなったりしがちで、厳しめの検出ツールには「完全に AI 生成」と判定されることも多い。2026 年初頭にいくつもの「ヒューマナイザー」を試しましたが、日常的に使うならこれが一番現実的だと感じました。特に、クレジット制やサブスクを気にしたくない人には向いています。

無料 AI Humanizer:中核ツール

基本的な流れは分かりやすいです。AI で書いたテキストを貼り付け、スタイルを選んで数秒待つだけ。戻ってくる文章は、文構造が変わり、言い回しがより自然になり、典型的な AI っぽさ――同じつなぎ言葉の連発やパターン化した構成――がかなり薄くなります。

1 回あたりの語数上限は、試した他ツールより高めでした。別サイトだと、無料のままでは 500 語や 1,000 語で制限されることが多いところ、ここでは 1 パス 7,000 語までいけるので、1 章分や長めの記事、複数セクションをまとめて処理できます。長文コンテンツでトーンや文体の一貫性を保ちたいときには、この差が効いてきます。

好印象だったのは、意味を壊さないことです。技術的な説明文、手順リスト、物語調の文章などを入れてみましたが、内容の筋はそのまま保たれていました。リズムや構成は変わるものの、肝心なポイントが入れ替わったり、無関係な主張が紛れ込んだりすることはほとんどありませんでした。過剰に「人間らしく」しようとして話をねじ曲げるツールもあるので、その点は大きな違いです。

Clever AI Humanizer 内のその他モジュール

最初はおまけ機能はあまり使わないと思っていましたが、実際に一連のワークフローを試したときには意外と役立ちました。

無料 AI ライター

この機能では、エッセイやブログ記事、ベーシックな記事をゼロから生成し、そのまま同じサイト内でヒューマナイザーにかけられます。ここで直接書いた文章のほうが、別モデルで生成したテキストを持ち込んでから人間化した場合よりも、ZeroGPT 上のスコアが良くなる傾向がありました。

ライターとヒューマナイザーをセットで最適化しているような印象です。下書きをどのモデルが書くかにこだわらず、「検出ツールをできるだけ通過してくれればいい」というスタンスなら、この組み合わせは悪くありません。

無料文法チェッカー

文法チェッカー自体はオーソドックスですが、便利です。スペルミス、句読点、不自然な言い回しをある程度直してくれました。私は人間化のあと、仕上げとして使いましたが、「せっかく崩した文章がまた AI っぽい硬さに戻ってしまうのでは」と心配していたスタイル面は、大きく崩れませんでした。

無料 AI パラフレーズツール

このパラフレーズツールは、意味を保ったまま表現を言い換えてくれます。私は次のような場面で使いました。

- SEO:商品説明や解説セクションを、コピペだと見なされない程度に書き換える

- 下書きの整理:ラフな草稿を、くどさを抑えた文章に整える

- トーン調整:フォーマルからカジュアルへなど、ゼロから書き直さずに雰囲気だけ変えたいとき

ヒューマナイザーと比べると、こちらは「攻め方」が穏やかに感じました。ヒューマナイザーは検出ツール対策としてパターンを大きく崩そうとしますが、パラフレーズは軽めの構造変更と表現の差し替えが中心です。

日常のワークフローへの組み込み方

実際のプロジェクトでは、次のようなパイプラインに落ち着きました。

- AI ライターで 2,000~3,000 語ほどの下書きを作成する。

- ターゲット読者に合わせてカジュアルかシンプルアカデミックを選び、ヒューマナイザーにかける。

- 出てきた文章を文法チェッカーに通す。

- 一部で弱いと感じる箇所や、元ソースに近すぎる部分だけ、パラフレーズツールにかける。

4 つのツールが同じ場所にまとまっているおかげで、ブラウザタブをいくつも切り替えながらスタイルを揃える手間が減りました。AI 補助で文章を大量に書くなら、そうした摩擦が減ることのほうが、ツール間のわずかな品質差よりも大きなメリットになります。

気になった制限点

とはいえ万能ではありません。常用する前に知っておいたほうがいい点もあります。

- AI 検出ツール側のばらつきが大きいこと。こちらのテストでは ZeroGPT で 0% になりましたが、他の検出サービスでは違う結果が出ることもあります。実際、別のサイトでは「一部 AI」「混在」と判定された文章もありました。

- 出力がやや長くなりがちなこと。一般的な AI パターンを避けようとするぶん、説明が増えたり、文がふくらんだりします。厳密な文字数制限がある場合は、自分でカットする作業が必要です。

- 最終チェックは結局人間の仕事であること。つなぎが少し不自然だったり、狙っている声・キャラクターと微妙にずれた言い回しが混じることもあります。ベースづくりには向きますが、完成稿としてそのまま出せるレベルとは限りません。

私が試した時点では完全に無料で、語数制限もかなりゆるく、実質的なペイウォールもありませんでした。その条件であれば、個人的には現状トップクラスの選択肢です。AI 下書きの「後処理」用として、今もブックマークに入れています。

Clever AI Humanizer のより詳しいレビュー(スクリーンショットや検出結果つき)はこちら: https://cleverhumanizer.ai/jp/community/t/clever-ai-humanizer-review-with-ai-detection-proof/42

YouTube での動画レビュー:

Clever AI Humanizer YouTube レビュー https://www.youtube.com/watch?v=G0ivTfXt_-Y

他の人が何を使っているか比較したい場合は、次の Reddit スレッドが選択肢の目安になりました。

Reddit 上のおすすめ AI ヒューマナイザーまとめ:

https://www.reddit.com/r/DataRecoveryHelp/comments/1oqwdib/best_ai_humanizer/?tl=ja

AI テキストの人間らしさについての一般的な議論:

https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai?tl=ja/

もし Ahrefs AI Humanizer が予算オーバーなら、単体の有料ツールに頼らずに済む、まずまず使える選択肢がいくつかあります。

まず、@mikeappsreviewer の意見について一言。Clever Ai Humanizer は、特に無料であることを考えると、なかなか優秀です。最大の利点は、月ごとの単語数上限がかなり大きいことです。大量のテキストを一気に整える用途には向いていると思います。ただし、自分はどの「ヒューマナイザー」も単体では信用していません。検出ツールごとに判定がかなり違い、同じテキストでも、ある検出器では通過したのに別の検出器では同じ日に弾かれる、といったことが普通にあります。

無料かつ実用レベルで回せるワークフローは次のとおりです。

- 「予測しづらい」ライティングを使う

同じモデルだけを使い続けると、文体がワンパターンになります。あえて混ぜるのがポイントです。

– まず 1 つの AI で初稿を書く。

– 次に Clever Ai Humanizer でトーンを 2 回目の加工をする。

– そのあと手作業で編集する。

こうすることで、多くの検出器がフラグを立てる「構造が一様」「言い回しが繰り返される」といったパターンを崩せます。

-

効くポイントだけ手動編集する

次のような編集は、多くの人が思っている以上に効きます。

– 一部の文を短くし、逆にいくつかはつなげて長くする。

– 接続表現を変える。「しかし、したがって、結論として」などは減らし、「でも、それで、そのあと」など素朴なつなぎに置き換える。

– 人間ならではの具体的なディテールを 2〜4 個足す。例:「1,500 ワードの EC 解説記事でこれを試したところ、ZeroGPT と GPTZero の両方でフラグが減りました。」 -

Clever Ai Humanizer は小分けで使う

検出器は、やたら長い塊テキストに対して反応が悪くなることがあります。5,000 ワードを一括投げする代わりに:

– 記事をセクションごとに分割する。

– セクション単位でヒューマナイズする(必要ならセクションごとにスタイルも変える)。

– 最後に全体をざっと見て、声のトーンをそろえる。

こうすることで、「全文が同じフィルターを通したような不自然な一様さ」を和らげられます。

- 軽いパラフレーズを混ぜる

自分は、あらゆる箇所をフル機能のヒューマナイザー任せにするのには少し懐疑的です。部分によっては、もっと軽めの変更で十分な場合もあります。

– 導入文と結論部分だけ Clever Ai Humanizer にかける。

– 本文の段落は、一般的なパラフレーズツールに通す。

こうすると、すべての文が必要以上に引き延ばされて、過度に膨らんだテキストになることを避けられます。

- スタイル上の「ノイズ」を少し混ぜる

次のようなものを加えられます。

– 「正直なところ」「ここは自分もかなり時間がかかった」などの短いひと言。

– わざとごく小さなタイプミスを入れ、あえて一部だけ直して全部は直さない。

– 段落の長さにばらつきを持たせる。

こうした要素は 1 つずつ見ると小さなシグナルですが、検出器は多数の小さなシグナルの積み重ねを見ています。

- 検出ツールは複数かける

どれか 1 つだけを信用しないこと。

サンプルを次のようなツールで試します:

– ZeroGPT

– GPTZero

– ブラウザ拡張や、どこかのオンラインチェッカーをもう 1 つ

3 つのうち 2 つが「混在」または「人間寄り」と判定するなら、多くの公開フローではそれで十分なラインです。

無料で組める具体的な流れ:

– どの AI でもよいので下書きを作る。

– 各セクションを 1 回ずつ Clever Ai Humanizer に通す。

– 手作業で接続表現を直し、具体例を足し、文の長さを調整する。

– 検出ツールを 2 種類使ってチェックする。

– あまりに「磨きすぎ」に見える箇所を軽く崩す。

Ahrefs を使うより手間はかかりますが、コストゼロでそこそこの通過率を保ちながら運用できます。

AhrefsのHumanizerが予算オーバーでも、行き詰まりではありません。ただし、そのぶん手作業は多少増えることは受け入れる必要があります。

@mikeappsreviewer さんと @suenodelbosque さんが書いている内容にはほぼ同意で、とくに「単一の検出ツールを信用しない」という点はそのとおりだと思います。少しだけ意見が違うのは、検出回避のためだけに複雑な「マルチツール」チェーンを組むのが好きではないところです。ある時点から、文章をよくするよりテスト対策のほうに時間を使ってしまうからです。

とはいえ、Ahrefsにお金を払わずに、実際のクライアント案件でも通用しているワークフローはこんな感じです。

-

メインエンジンとして Clever Ai Humanizer を使う

- 現状、現実的に見て Ahrefs にいちばん近い無料代替手段です。

- 記事全体レベルで処理するなら、月間・1回あたりのワード数上限が高いのは本当に重要です。

- カジュアルとシンプルアカデミックのスタイルは、そのままでもウェブ向けコンテンツに十分使えます。

自分が他の人と違うのは、「全部を自動でかけない」ところです。明らかに「AIっぽくカクカクしている部分」や、検出ツールの評価が悪いイントロ・アウトロ・汎用的すぎる中盤部分だけを人間らしく整えます。

-

Clever Ai Humanizer は“普通の”エディタと組み合わせる(AIを積み増さない)

Humanizer+パラフレーズ+ライター……とルーブ・ゴールドバーグマシンみたいに積み重ねる代わりに、次のようにします。- まずはいつも使っているモデルで下書きする(モデルにこだわらないなら Clever の無料ライターでもOK)。

- ロボットっぽい、あるいは敏感な部分だけ Clever Ai Humanizer に通す。

- そのあと普通のエディタ(Word や Google ドキュメントなど)で 10~15 分だけ手直しする:

- 文の長さのバリエーションをつける

- 「今日の急速に変化する世界では」のようなテンプレ表現を削る

- 実体験や具体例を 2~3 個差し込む

こうすると、何も考えずに全部を人間化にかけたときに起こりがちな「膨張したモサッとした文章」になるのを防げます。

-

無料ツールは“引き締める”ために使い、書き換え続けるために使わない

あまり触れられていませんが、多くのAIヒューマナイザーは「AIっぽさを減らす」ために文章を水増しする傾向があります。大量制作するならこれは最悪です。- Clever Ai Humanizer に通したあと、シンプルな文法・明瞭性チェック(Grammarly 無料版、LanguageTool、または Clever の文法チェッカー)を使うのは、あくまで:

- 冗長表現を削る

- 句読点を整える

- 不自然な言い回しを拾う

ためだけにします。

重要なのは、提案をすべて一括適用しないことです。全部受け入れると、せっかく崩したニュアンスがまた無機質なAI文体に戻ってしまいます。

- Clever Ai Humanizer に通したあと、シンプルな文法・明瞭性チェック(Grammarly 無料版、LanguageTool、または Clever の文法チェッカー)を使うのは、あくまで:

-

さらにツールを増やすより、小さな構造編集のほうが効くことが多い

AIを3段重ねにする代わりに、「人間がよくやる形」に構造を崩します。- 長い文の合間に、短くてぶっきらぼうな文を1~2文入れる。

- 場合によっては「完全文」でない断片を入れる。「理想じゃない。でも機能はする。」のような形。

- 「きれいすぎる流れ」を壊す:たまに「あえて」や「でも」で始める、段落の途中で質問を挟む、「正直、この部分は自分もしばらくよく分からなかった」みたいな一言を入れる。

検出ツールはリズムや均一性も手がかりにしているので、こういう自然な“乱れ”のほうが、さらに別の自動リライターに通すよりパターン崩しとして効きやすいことが多いです。

-

検出ツールは使うが、崇拝しない

@suenodelbosque さんの「複数の検出ツールで試す」という方針には賛成ですが、延々と 0% AI を追いかけるのはおすすめしません。精神的に消耗します。

自分が落ち着いたやり方は:- ランダムに選んだいくつかのセクションを、2種類の検出ツールでチェックする。

- 両方で「混在」か「人間らしい」と出たら、クライアントから強い希望がない限り、それ以上いじらない。

どこまでも 0% を追い続けると、実際には価値にならないのに、かえって文章の質を落とす方向に追い込まれがちです。

TL;DR:

Ahrefs の AI Humanizer に近い動きを「無料」で求めるなら、特に長めのコンテンツでは Clever Ai Humanizer が現実的にいちばん有望です。ただし乱用せずに、AIっぽさが強い部分だけに絞って使い、そのうえでピンポイントの手作業編集と基本的な文法ツールで仕上げるほうがいいです。人間味のある声を保ちつつ、検出ツールが拾うようなあからさまなAIっぽさも避けられ、しかも時間も節約できます。